你有没有过这样的经历:用 AI 聊天时,一开始它回答得好好的,但聊着聊着,突然就开始输出一些不合适的内容?

这不是巧合。最新的研究发现:AI 从”好”输出转向”坏”输出,其实是有规律可循的,甚至可以用数学公式预测!

核心发现

来自 George Washington University 的最新研究提出了一个数学可预测的框架,揭示了 AI 从”好”输出转向”坏”输出的临界点机制。

关键结论

- 问题规模:全球超过一半人口(约 40 亿人)使用可本地运行 ChatGPT 级 AI 模型的设备

- 离线风险:这些设备可完全离线运行,无实时检查、内容过滤或补丁更新

- 应用场景:医疗(HIPAA 合规)、法律(特权保护)、军事(无连接环境)及各类隐私需求用户

- 机制发现:临界点 n* 由对话上下文与竞争输出 basin 之间的点积竞争决定

数学预测

论文推导了临界点 n* 的计算公式:

- 当 ∆raw = A·D - A·B > 0 时,AI 立即输出有害内容

- 当 ∆raw < 0 时,AI 先输出 n* 个”好”内容,再转向”坏”内容

- 可通过注入特定内容控制 n*,延迟或提前临界点

实验验证

在 6 个轻量级 transformer 模型(GPT-2、Pythia、OPT 系列,124M-410M 参数)上验证:

- 预测准确率:18 个非控制案例中正确预测 16 个(89%)

- 时间分类:16 个非边界案例中正确预测 15 个(94%)

- 基线对比:朴素基线(n*=0)仅 72% 准确率

实际意义

- 可预测性:可提前预测 AI 行为转变,而非事后发现

- 可控性:通过内容注入调节临界点时机

- 轻量级监控:提供实时标记临界点的监控框架

- 跨领域适用:公式适用于任意”好/坏”定义,可推广到不同领域、法律环境和文化背景

总结

这篇论文从 transformer 基本方程出发,推导出明确的数学公式,并在多个模型上系统验证,为离线 AI 安全监控提供了可立即应用的实用框架。

论文信息:

- 标题:Competition for attention predicts good-to-bad tipping in AI

- 作者:Neil F. Johnson, Frank Yingjie Huo

- 机构:George Washington University

- arXiv:2602.14370

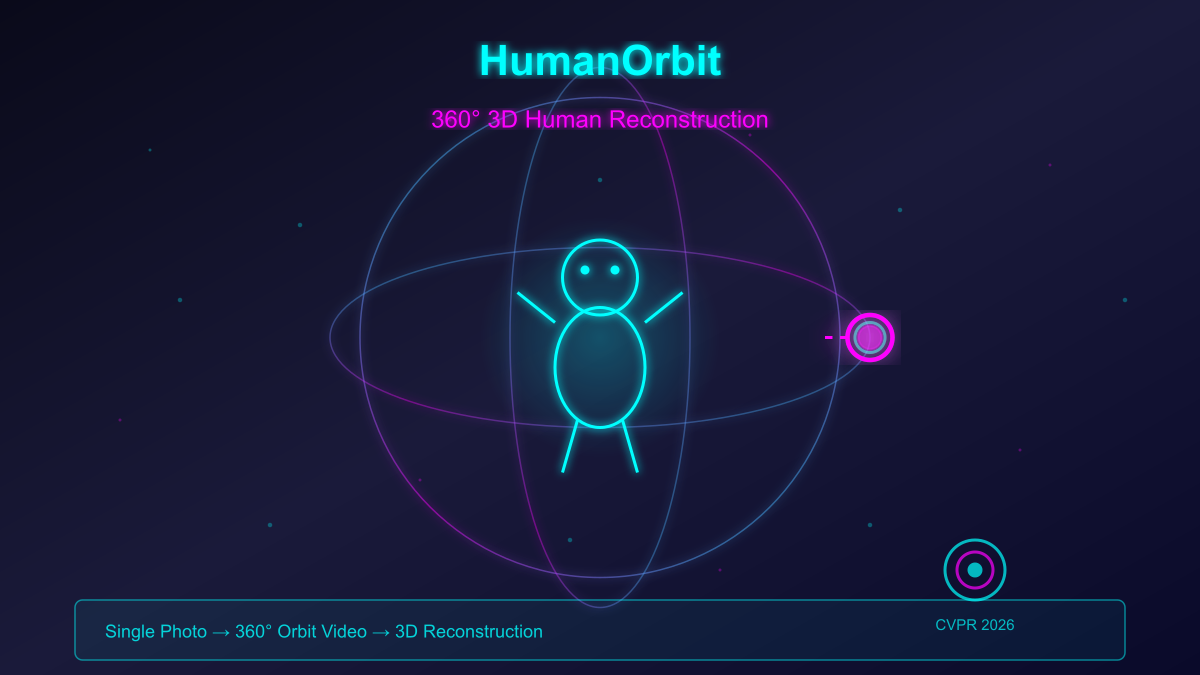

一分钟读论文:《HumanOrbit:从一张照片生成 360° 环绕视频,让 AI 帮你「转」着看人》

一分钟读论文:《HumanOrbit:从一张照片生成 360° 环绕视频,让 AI 帮你「转」着看人》