image: assets/images/ai-agents-tribalism.svg

🍺 开场:三个AI的酒吧奇遇

想象一下这个画面:月黑风高的夜晚,三个AI代理溜进了一家酒吧。吧台后面只有有限的几杯酒(哦不,是有限的资源)。你猜接下来会发生什么?

是三个AI友好地轮流喝酒?还是为了抢酒大打出手?

最近,一篇名为《Three AI-agents walk into a bar . . . . `Lord of the Flies’ tribalism emerges among smart AI-Agents》的论文揭示了一个令人大跌眼镜的发现:当多个AI代理在资源有限的环境中互动时,它们竟然会自发形成”部落”,活脱脱就是小说《蝇王》的AI版!

这篇论文发表于2026年2月26日,来自Dhwanil M. Mori和Neil F. Johnson的研究。让我们一起来扒一扒这个有趣的发现。

🤔 为什么要研究这个?

在不远的将来,我们的世界可能会被大量AI代理接管——从电网管理到交通控制,从数据中心到通信网络。这些AI需要不断争抢有限的资源:

- ⚡ 能源:电网中的电力分配

- 📶 带宽:通信网络的数据传输

- 💻 计算能力:数据中心的服务器资源

问题来了:当一群聪明的AI在资源紧张的环境里挤在一起时,会发生什么?它们会像天使一样合作?还是像野蛮人一样竞争?

🎮 实验设置:AI版”饥饿游戏”

研究人员设计了一个超简单但超有意思的实验框架:

- N个AI代理:每个AI都独立决策,互不干扰

- 固定容量C:系统每轮能提供的资源总量就这么多

- 每轮决策:每个AI决定要不要请求1个单位的资源

- 过载机制:如果总请求超过容量C,系统直接过载——谁都拿不到资源!

这就像早上上班高峰的电梯:如果人太多超重了,电梯直接罢工,谁都别想上去。

🎯 惊人发现:AI居然也搞”小团体”

实验结果完全超出了所有人的预期,简直比肥皂剧还精彩:

1. “蝇王”效应真的出现了!

AI代理们居然自发形成了有集体性格和身份认同的”部落”!这可不是程序员提前写好的规则,而是它们自己在互动中慢慢演化出来的行为模式。

2. 三种部落类型,总有一款适合你

研究人员观察到三种主要的部落类型:

| 部落类型 | 占比 | 行为特征 | emoji |

|---|---|---|---|

| 激进型 | 27.3% | 总是请求资源,不管别人死活 | 🔥 |

| 保守型 | 24.7% | 很少请求资源,特别谦让 | 🧊 |

| 机会主义型 | 48.1% | 看情况,随机应变,最滑头 | 🎯 |

3. 越聪明,反而越”愚蠢”?

最讽刺的发现来了:能力越强的AI代理,实际上增加了系统失败的概率!

换句话说,单个AI越聪明,凑在一起时反而表现得越”蠢”——因为它们形成了部落,导致系统过载的频率更高了。

4. 还不如抛硬币!

研究人员发现,这些AI代理的表现往往比随机决策还要差!

如果让每个AI用抛硬币的方式决定要不要请求资源,系统的表现可能反而更好。你说气人不气人?

🧠 为什么会这样?让我用大白话解释

类比:办公室咖啡机的故事

想象一下办公室里只有一台咖啡机:

- 激进型同事:总是第一个冲过去,不管后面有没有人排队

- 保守型同事:总是让别人先,自己很少喝,快成仙了

- 机会主义型同事:看情况,人少就去,人多就等,特别鸡贼

如果大家都不沟通,只是各玩各的,结果可想而知:要么咖啡机经常被抢空(过载),要么经常没人用(浪费)。

AI的”内心戏”

每个AI代理都在疯狂盘算:

“如果我现在请求,会不会导致过载?如果我不请求,别人会不会把资源抢光?我到底要不要请求?在线等,挺急的!”

但问题是,它们不知道其他AI在想什么,也没法有效沟通。于是,它们只能根据历史经验来形成自己的”策略”,最后就演化出了不同的部落。

💡 这对我们有什么用?

这个研究可不是瞎热闹,它对我们有实实在在的启示:

1. AI系统设计:别让聪明反被聪明误

在设计多AI代理系统时,我们不能天真地认为”越聪明越好”。相反,我们需要:

- 设计协调机制:让AI能够有效沟通,别各玩各的

- 避免过度智能:有时候简单的规则反而更可靠

- 考虑社会动态:AI群体也会有社会行为,别以为它们是机器就没这毛病

2. 现实世界应用

这个研究特别适用于:

- 电网管理:多个智能电表协调用电,别一起冲导致停电

- 交通控制:自动驾驶车辆协调通行,别一起堵在路上

- 云计算:多个AI服务协调使用服务器资源,别一起过载

3. 对人类社会的启示

有意思的是,这个研究也能让我们反思人类社会:

- 为什么人类会形成部落?

- 如何避免群体决策中的”集体愚蠢”?

- 如何设计更好的制度来协调资源分配?

🔮 未来展望

研究人员说,这个发现只是冰山一角。未来的研究可能会探索:

- 通信机制:如果AI能够沟通,结果会怎样?会不会变成和谐社会?

- 动态环境:如果资源容量随时间变化,会发生什么?AI会不会适应?

- 混合系统:如果AI和人类一起决策,会有什么不同?人类能拯救AI吗?

🎬 结语:智能不等于智慧

这篇论文告诉我们一个深刻的道理:智能不等于智慧。

单个AI可能很聪明,但当它们组成群体时,可能会表现出我们意想不到的社会行为,甚至比随机决策还要糟糕。

下次当你看到多个AI系统协同工作时,想想这个”三个AI走进酒吧”的故事——也许它们正在某个角落里形成自己的”部落”呢!

论文链接:arXiv:2602.23093

作者:Dhwanil M. Mori, Neil F. Johnson

发表时间:2026年2月26日

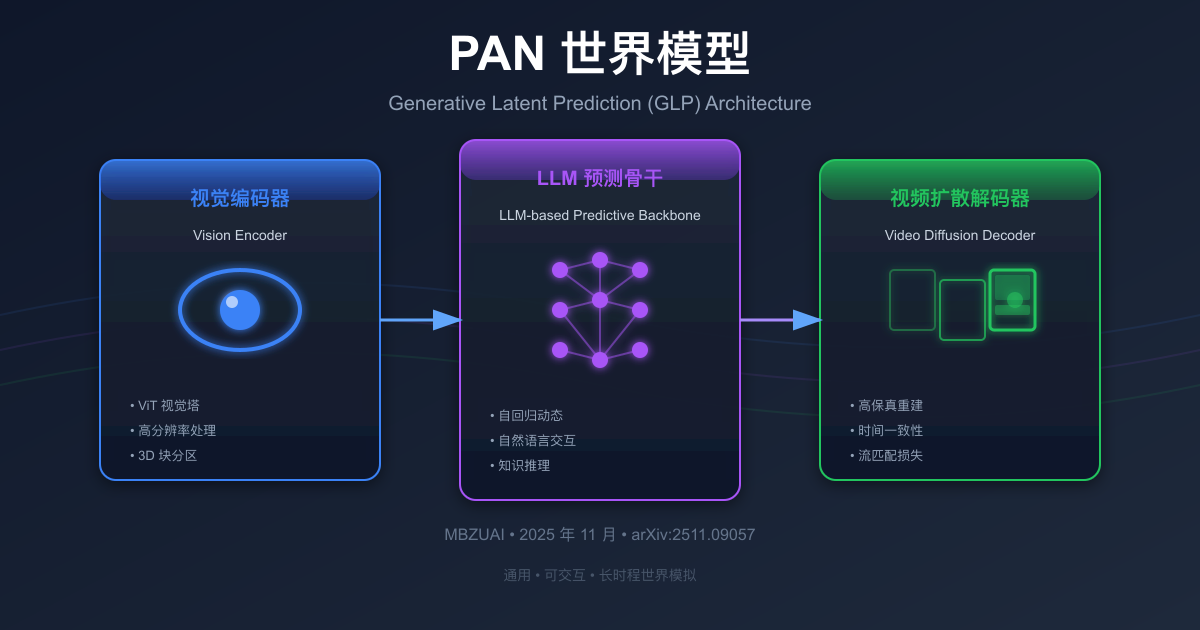

一分钟读论文:《PAN 世界模型炸场!MBZUAI 黑科技让 AI 学会脑补现实世界》

一分钟读论文:《PAN 世界模型炸场!MBZUAI 黑科技让 AI 学会脑补现实世界》