训练智能体(Agent)最大的瓶颈是什么?是缺乏足够多样化、可执行、可靠的环境!

如果你想训练一个能处理各种日常任务的 AI 智能体,你需要让它在不同的场景中学习——电商管理、银行系统、任务管理等等。但问题是:哪来这么多真实、可执行的环境?

最新的研究给出了一个革命性的解决方案:用代码驱动的方式自动生成 1000 个合成环境,让智能体在无限多样的场景中学习!

核心观点

这个突破来自 Snowflake 实验室的最新研究。他们提出了一个名为 Agent World Model 的系统,彻底解决了智能体训练的环境瓶颈问题。

技术亮点

1. 代码驱动的环境生成,不是 LLM 模拟

传统方法用 LLM 来模拟环境状态转移,但这种方式不稳定、不可靠。AWM 的突破在于:

- 完全代码化:每个环境都是真实可执行的 Python 代码

- 数据库支持:用 SQL 数据库管理状态,提供一致的状态转移

- 自动测试:生成的环境会自动测试和修复,确保可执行性

2. 1000 个环境,平均每个 35 个工具

AWM 生成的环境覆盖了各种日常场景:

- 电商管理(产品、订单、库存)

- 银行系统(账户、交易、报表)

- 任务管理(项目、任务、团队)

- 等等…

每个环境都有丰富的工具集,智能体可以通过多轮工具调用来完成复杂任务。

3. 混合奖励信号

- 步骤级奖励:格式检查、语法验证

- 任务级奖励:基于最终数据库状态和任务规范的混合评判(代码 + LLM)

4. 高效训练

- 1024 个并行环境实例

- 历史感知的训练策略

- 比 LLM 模拟快几个数量级

实际应用

1. 智能体训练

AWM 提供了第一个大规模、开源的可执行环境集合,专门用于强化学习。研究人员可以用它来训练和评估智能体。

2. 基准测试提升

论文在三个分布外基准上都取得了显著提升:

- BFCLv3:8B 模型从 53.83 → 65.94(+12.11)

- τ²-bench:14B 模型达到 39.03 Pass@1

- MCP-Universe:8B 模型从 6.70 → 11.17

🏆 AWM 是唯一一个在所有三个基准上都超越基线的方法!

3. 开源资源

- 📄 论文:arxiv.org/abs/2602.10090

- 💻 代码:Snowflake-Labs/agent-world-model

- 📦 数据集:Snowflake/AgentWorldModel-1K

- 🤖 模型:Arctic-AWM-4B/8B/14B

意义影响

1. 解决了智能体训练的基础设施问题

AWM 填补了智能体 AI 研究中的一个基础设施工具缺口,提供了第一个大规模、开源的可执行环境集合。

2. 验证了合成数据的价值

这项工作证明了,在多样化的合成环境上训练可以产生具有强大真实世界能力的智能体,验证了合成数据作为开发通用自主智能体的可行路径。

3. 代码 > LLM 模拟

AWM 的一个关键洞见是:代码驱动的环境比 LLM 模拟的环境提供更稳定的学习信号,而且速度快几个数量级。

这对未来的智能体训练具有重要的指导意义。

总结

Agent World Model 代表了智能体训练的一个重大进步。通过用代码生成 1000 个多样化、可执行的环境,它为智能体研究提供了强大的基础设施。

如果你正在研究智能体、强化学习,或者对合成数据的应用感兴趣,这篇论文绝对值得一读!

论文信息:Zhaoyang Wang, Canwen Xu, Boyi Liu, Yite Wang, Siwei Han, Zhewei Yao, Huaxiu Yao, Yuxiong He. “Agent World Model: Infinity Synthetic Environments for Agentic Reinforcement Learning”. arXiv:2602.10090, 2026.

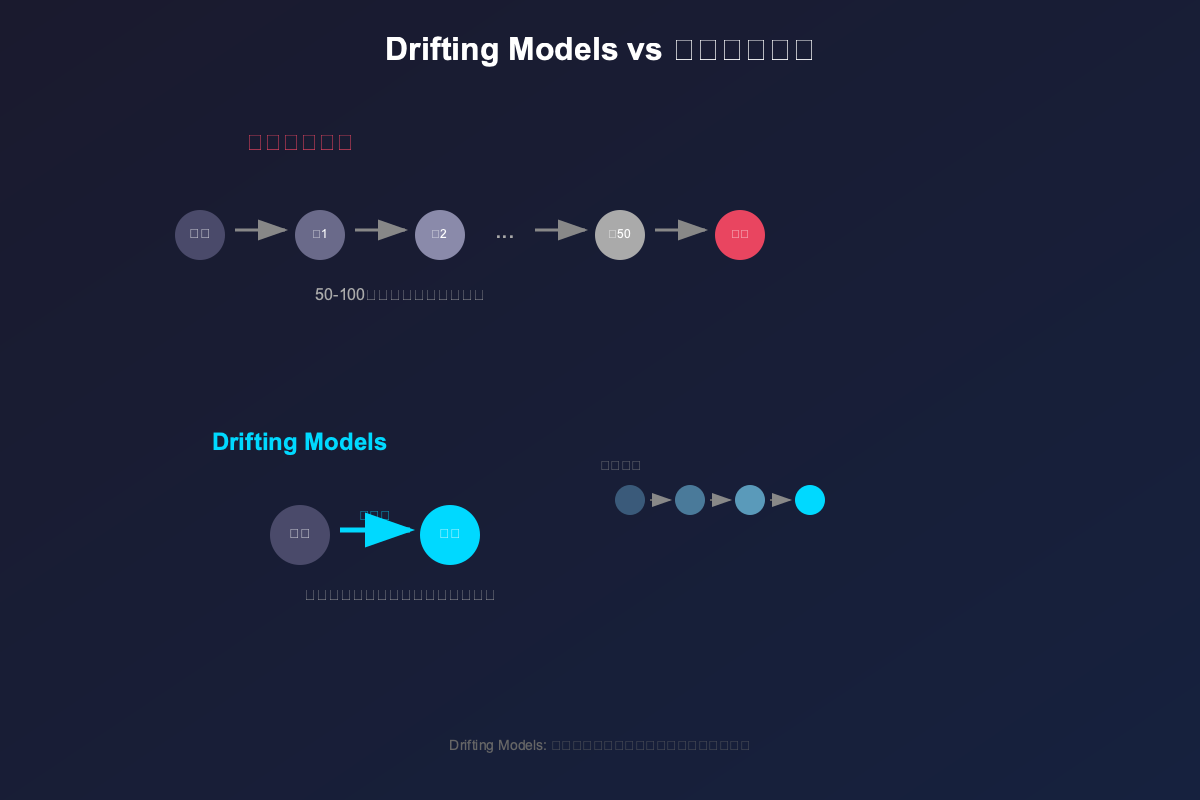

一分钟读论文:《何恺明团队再出大招:Drifting Models 挑战扩散模型,单步生成高质量图像》

一分钟读论文:《何恺明团队再出大招:Drifting Models 挑战扩散模型,单步生成高质量图像》