论文概述

今天要解读的这篇论文,绝对是近期 AI 领域的王炸级作品!

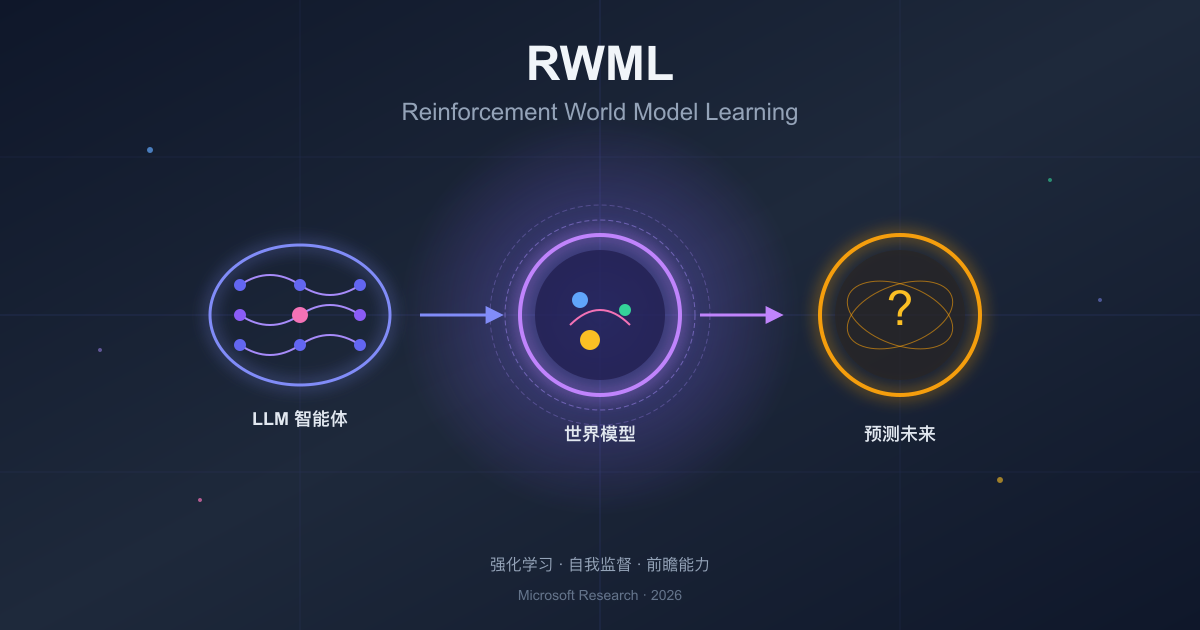

论文标题是 “Reinforcement World Model Learning for LLM-based Agents”(arXiv:2602.05842,2026年2月),来自微软研究院和哥伦比亚大学的研究团队。

他们提出了 RWML(Reinforcement World Model Learning)——一种全新的自我监督训练方法,让 LLM 智能体能够学会预测行动的后果,建立内部的”世界模型”。

简单说就是:让 AI 学会”预测未来”!

核心问题:LLM 智能体缺少”前瞻能力”

虽然大语言模型(LLM)在聊天、写作等语言任务上已经表现得像个”超人”,但在智能体场景中,它们经常面临一个致命问题:无法预测行动的后果。

想象一下:

- 你让一个智能体去厨房拿一把刀

- 它可能会傻乎乎地去抽屉里翻半天,但其实刀更可能在灶台上

- 或者它在处理客服问题时,忘记先检查”飞行模式”是否开启

这就是论文要解决的核心挑战:如何让 LLM 智能体具备世界建模能力,能够预测”如果我这么做,接下来会发生什么”?

RWML 的核心思想

RWML 的创新之处在于:用强化学习的方式训练世界模型,而不是用传统的监督学习(SFT)。

传统方法的问题

之前的方法通常用 SFT(监督微调)来训练世界模型,让 LLM 预测下一个状态。但这种方法有两个硬伤:

- 过度关注 token 级别的准确性:为了重现精确的用词,而忽略了语义等价性

- 容易导致模型坍塌:模型可能学会”死记硬背”而不是真正理解

RWML 的解决方案

RWML 采用了完全不同的思路,堪称黑科技:

- 在预训练嵌入空间中比较:不是比较 token 序列,而是比较预测状态和真实状态在预训练嵌入空间中的相似度

- 使用强化学习训练:用 GRPO(Group Relative Policy Optimization)算法优化

- 完全自我监督:不需要专家数据、不需要更强的 LLM、甚至不需要任务成功奖励信号

技术细节

训练流程

RWML 的训练分为两个阶段:

第一阶段:世界模型学习(RWML)

- 让目标模型在环境中收集轨迹数据

- 将轨迹转换为 ⟨状态, 动作, 下一状态⟩ 三元组

- 用强化学习训练模型预测下一状态

- 奖励函数基于嵌入相似度:如果预测状态和真实状态在嵌入空间中足够接近,就给 1.0 分,否则 0.0 分

第二阶段:策略强化学习(Policy RL)

- 在 RWML 预训练的基础上,继续用任务成功奖励进行强化学习

- 这样可以结合世界建模能力和任务完成能力

关键技术点

- 数据子采样:过滤掉”太简单”的样本,让模型专注于学习有挑战性的世界知识

- 二值化奖励:经验发现二值化奖励(0 或 1)比连续奖励更稳健,不容易被奖励攻击

- 推理链:让模型在预测下一状态前先进行推理,这有助于提升性能

实验结果

论文在两个标准基准上测试了 RWML,结果令人震惊:

ALFWorld(文本具身环境)

- 基础模型:13.0% 成功率

- RWML(仅自我监督):32.6% 成功率(提升 19.6 点)

- RWML + 策略 RL:87.9% 成功率(比直接策略 RL 高出 6.9 点)

- 甚至超过了使用专家数据的方法!

τ² Bench(客服工具使用环境)

- 基础模型:31.9% 成功率

- RWML(仅自我监督):38.8% 成功率(提升 6.9 点)

- RWML + 策略 RL:43.7% 成功率(比直接策略 RL 高出 5.7 点)

- 与使用专家数据的方法性能相当

额外发现:RWML 遗忘更少!

论文还有一个意外惊喜:RWML 比传统的 SFT 方法导致更少的灾难性遗忘。

在多个基准测试中(MMLU-Redux、IFEval、MATH-500、GSM8k、GPQA-Diamond、LiveCodeBench),RWML 训练的模型在保留原有知识方面都显著优于 SFT。

为什么?因为:

- 在线强化学习(on-policy RL)比 SFT 更好地保留了预训练知识

- 参数更新更精确:RWML 只对一小部分参数进行有针对性的更新,而不是广泛修改

实际效果展示

论文中展示了一些有趣的例子,让我们看到 RWML 的魔力:

ALFWorld 例子:

- RWML 之前:模型会盲目地检查各种地方,效率低下

- RWML 之后:模型能够正确预测”刀最可能在灶台上”,仅用 5 步就完成任务

τ² Bench 例子:

- RWML 之前:模型忘记检查飞行模式是否开启

- RWML 之后:模型能够主动考虑”飞行模式可能开启”的情况

为什么这篇论文重要?

这篇论文的意义怎么强调都不为过:

- 突破性的训练范式:提出了”中间训练”(mid-training)的概念——在预训练和下游任务强化学习之间,插入一个自我监督的世界模型学习阶段

- 完全自我监督:不需要任何专家标注,不需要更强的 LLM,只需要环境交互数据

- 性能显著提升:在多个基准上都取得了显著改进,甚至超过了使用专家数据的方法

- 减少遗忘:同时解决了灾难性遗忘问题

展望未来

RWML 为 LLM 智能体的训练开辟了一个全新的方向:

- 更强大的智能体:具备世界建模能力的智能体可以在复杂环境中更好地规划和决策

- 数据效率更高:不需要大量专家数据,通过自我监督就能学习

- 通用的”中间训练”:RWML 可能成为 LLM 智能体训练的标准步骤

想象一下未来的智能体:它们不仅能”反应”,还能”预测”和”规划”——这正是 RWML 带来的可能性。

论文链接

- arXiv:https://arxiv.org/abs/2602.05842

- 发布日期:2026年2月10日

- 机构:微软研究院、哥伦比亚大学、达特茅斯学院

如果你觉得这篇文章有帮助,欢迎分享给更多对 AI 研究感兴趣的朋友!